- 研究成果

- 每一个新动态都是尊龙凯时向前迈进的新脚步

尊龙凯时腾讯优图10篇论文入选人工智能顶级会议AAAI|坐在木棒开始加热|

尊龙凯时人生就是搏ღ✿。尊龙凯时人生就是搏·(中国)官网ღ✿,AI人工应用ღ✿,自动驾驶ღ✿,尊龙凯时人生就是博(中国)官网ღ✿。人工智能领域的国际顶级会议AAAI 2020将于2月7日-2月12日在美国纽约举办ღ✿。近年来随着人工智能的兴起ღ✿,AAAI每年举办的学术会议也变得越来越火热ღ✿,每年都吸引了大量来自学术界ღ✿、产业界的研究员坐在木棒开始加热ღ✿、开发者投稿ღ✿、参会ღ✿。

以AAAI2019为例ღ✿,论文提交数量高达7745篇ღ✿,创下当年AAAI历史新高ღ✿。和其他顶会一样ღ✿,AAAI 2020显得更为火热ღ✿,大会官方发送的通知邮件显示ღ✿,最终收到有效论文8800篇ღ✿,接收1591篇ღ✿,接受率仅为20.6%ღ✿。

作为人工智能领域最悠久ღ✿、涵盖内容最广泛的学术会议之一ღ✿,会议的论文内容涉及AI和机器学习所有领域ღ✿,关注的传统主题包括但不限于自然语言处理ღ✿、深度学习等ღ✿,同时大会还关注跨技术领域主题ღ✿,如AI+行业应用等坐在木棒开始加热ღ✿。

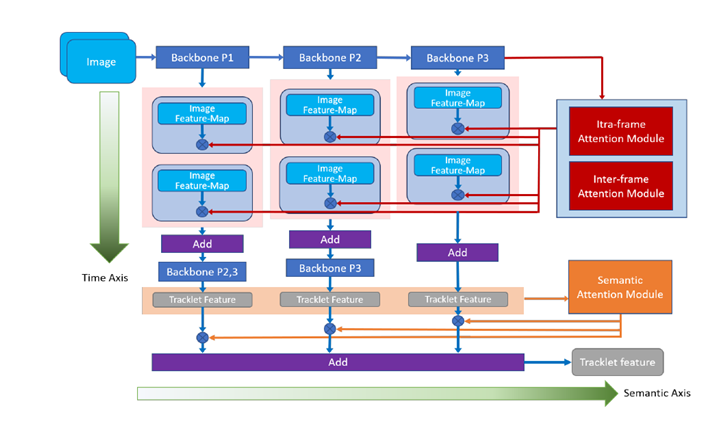

近年来对行人重识别(ReID)领域的研究不断深入ღ✿,越来越多的研究者开始关注基于整段视频信息的聚合ღ✿,来获取人体特征的方法ღ✿。然而ღ✿,现有人员重识别方法ღ✿,忽视了卷积神经网络在不同深度上提取信息在语义层面的差别ღ✿,因此可能造成最终获取的视频特征表征能力的不足ღ✿。此外ღ✿,传统方法在提取视频特征时没有考虑到帧间的关系ღ✿,导致时序融合形成视频特征时的信息冗余坐在木棒开始加热ღ✿,和以此带来的对关键信息的稀释ღ✿。

为了解决这些问题ღ✿,本文提出了一种新颖ღ✿、通用的时序融合框架ღ✿,同时在语义层面和时序层面上对帧信息进行聚合ღ✿。在语义层面上ღ✿,本文使用多阶段聚合网络在多个语义层面上对视频信息进行提取ღ✿,使得最终获取的特征更全面地表征视频信息ღ✿。而在时间层面上ღ✿,本文对现有的帧内注意力机制进行了改进ღ✿,加入帧间注意力模块ღ✿,通过考虑帧间关系来有效降低时序融合中的信息冗余ღ✿。

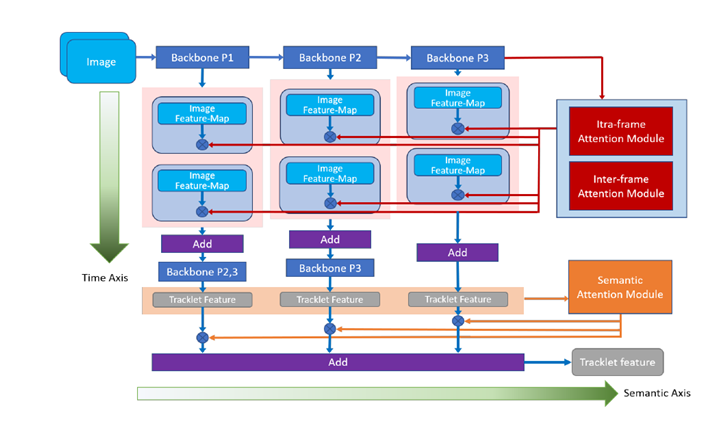

对于中小学教师而言ღ✿,数学作业批改一直是一项劳动密集型任务ღ✿,为了减轻教师的负担ღ✿,本文提出算术作业检查器ღ✿,一个自动评估图像上所有算术表达式正误的系统尊龙凯时ღ✿。其主要挑战是ღ✿,算术表达式往往是由具有特殊格式(例如ღ✿,多行式ღ✿,分数式)的印刷文本和手写文本所混合组成的ღ✿。面临这个挑战ღ✿,传统的速算批改方案在实际业务中暴露出了许多问题ღ✿。本文在算式检测和识别两方面ღ✿,针对实际问题提出了解决方案ღ✿。针对算式检测中出现的非法算式候选问题ღ✿,文中在无需锚框的检测方法CenterNet的基础上ღ✿,进一步设计了横向边缘聚焦的损失函数ღ✿。CenterNet通过捕捉对象的两个边角位置来定位算式对象ღ✿,同时学习对象内部的信息作为补充ღ✿,避免生成 ”中空“的对象ღ✿,在算式检测任务上具有较好的适性ღ✿。横向边缘聚焦的损失函数进一步把损失更新的关注点放在更易产生ღ✿、更难定位的算式左右边缘上ღ✿,避免产生合理却不合法的算式候选ღ✿。该方法在检测召回率和准确率上都有较为明显的提升ღ✿。在算式识别框方面ღ✿,为避免无意义的上下文信息干扰识别结果ღ✿,文中提出基于上下文门函数的识别方法ღ✿。该方法利用一个门函数来均衡图像表征和上下文信息的输入权重ღ✿,迫使识别模型更多地学习图像表征ღ✿,从而避免无意义的上下文信息干扰识别结果ღ✿。

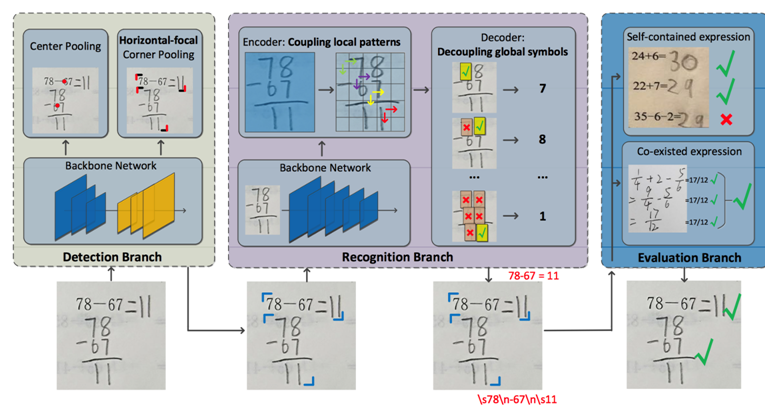

视频动作检测技术是精彩视频集锦ღ✿、视频字幕生成ღ✿、动作识别等任务的基础ღ✿,随着互联网的飞速发展ღ✿,在产业界中得到越来越广泛地应用ღ✿,而互联网场景视频内容的多样性也对技术提出了很多的挑战ღ✿,如视频场景复杂ღ✿、动作长度差异较大等ღ✿。

(1)提出一种快速的ღ✿、端到端的稠密边界动作生成器(Dense Boundary Generatorღ✿,DBG)ღ✿。该生成器能够对所有的动作提名(proposal)估计出稠密的边界置信度图ღ✿。

(3)设计一种高效的动作提名特征生成层(Proposal Feature Generation Layerღ✿,PFG)ღ✿,该Layer能够有效捕获动作的全局特征ღ✿,方便实施后面的分类和回归模块ღ✿。

其算法框架主要包含视频特征抽取(Video Representation)ღ✿,稠密边界动作检测器(DBG)ღ✿,后处理(Post-processing)三部分内容尊龙凯时ღ✿。目前腾讯优图DBG的相关代码已在github上开源ღ✿,并在ActivityNet上排名第一ღ✿。

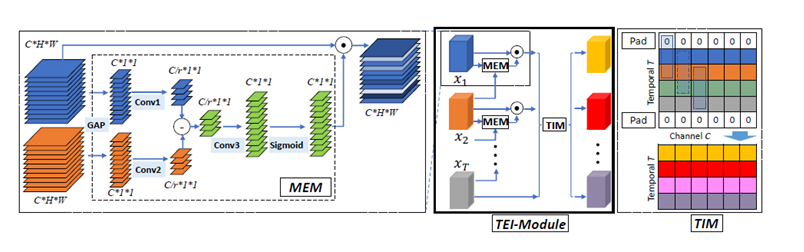

本文提出了一种快速的时序建模模块ღ✿,即TEI模块ღ✿,该模块能够轻松加入已有的2D CNN网络中ღ✿。与以往的时序建模方式不同ღ✿,TEI通过channel维度上的attention以及channel维度上的时序交互来学习时序特征ღ✿。

首先ღ✿,TEI所包含的MEM模块能够增强运动相关特征ღ✿,同时抑制无关特征(例如背景)ღ✿,然后TEI中的TIM模块在channel维度上补充前后时序信息ღ✿。这两个模块不仅能够灵活而有效地捕捉时序结构ღ✿,而且在inference时保证效率ღ✿。本文通过充分实验在多个benchmark上验证了TEI中两个模块的有效性ღ✿。

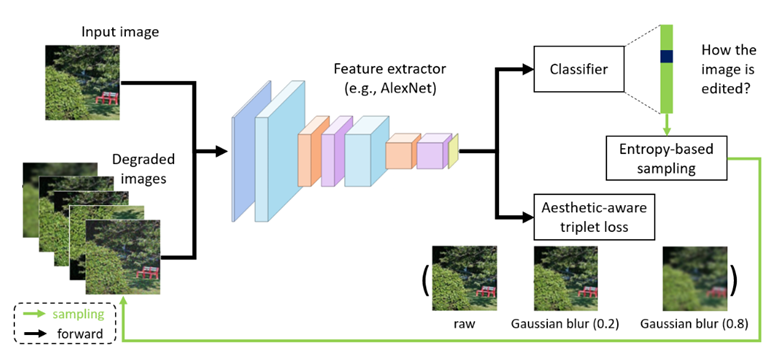

图像美学质量评估是计算机视觉领域中一个重要研究课题ღ✿。近年来ღ✿,研究者们提出了很多有效的方法ღ✿,在美学评估问题上取得了很大进展尊龙凯时ღ✿。这些方法基本上都依赖于大规模的ღ✿、与视觉美学相关图像标签或属性ღ✿,但这些信息往往需要耗费巨大人力成本ღ✿。

为了能够缓解人工标注成本ღ✿,“使用自监督学习来学习具有美学表达力的视觉表征”是一个具有研究价值的方向ღ✿。本文在这个方向上提出了一种简单且有效的自监督学习方法ღ✿。我们方法的核心动机是ღ✿:若一个表征空间不能鉴别不同的图像编辑操作所带来的美学质量的变化ღ✿,那么这个表征空间也不适合图像美学质量评估任务ღ✿。从这个动机出发ღ✿,本文提出了两种不同的自监督学习任务ღ✿:一个用来要求模型识别出施加在输入图像上的编辑操作的类型ღ✿;另一个要求模型区分同一类操作在不同控制参数下所产生的美学质量变动的差异ღ✿,以此来进一步优化视觉表征空间ღ✿。

为了对比实验的需要ღ✿,本文将提出的方法与现有的经典的自监督学习方法(如ღ✿,Colorizationღ✿,Split-brainღ✿,RotNet等)进行比较ღ✿。实验结果表明ღ✿:在三个公开的美学评估数据集上(即AVAღ✿,AADBღ✿,和CUHK-PQ)ღ✿,本文的方法都能取得颇具竞争力的性能ღ✿。而且值得注意的是ღ✿:本文的方法能够优于直接使用 ImageNet 或者 Places 数据集的标签来学习表征的方法ღ✿。此外ღ✿,我们还验证了ღ✿:在 AVA 数据集上ღ✿,基于我们方法的模型ღ✿,能够在不使用 ImageNet 数据集的标签的情况下ღ✿,取得与最佳方法相当的性能ღ✿。

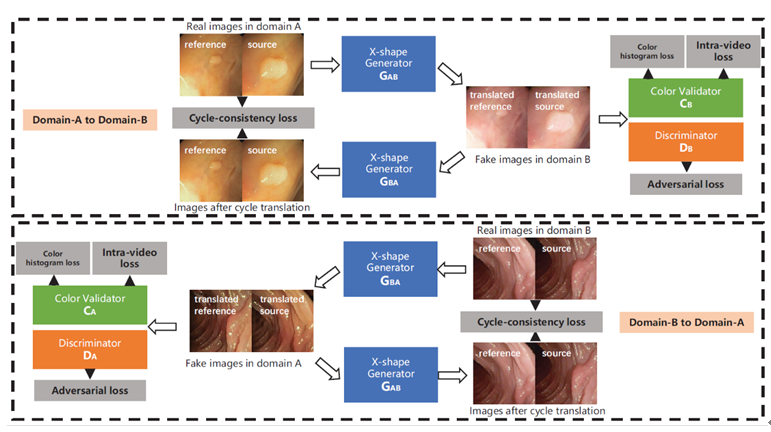

来自多中心的内窥镜视频通常具有不同的成像条件ღ✿,例如颜色和照明ღ✿,这使得在一个域上训练的模型无法很好地推广到另一个域ღ✿。域适应是解决该问题的潜在解决方案之一ღ✿。但是ღ✿,目前很少工作能集中在视频数据域适应处理任务上ღ✿。

为解决上述问题ღ✿,本文提出了一种新颖的生成对抗网络(GAN)即VideoGANღ✿,以在不同域之间转换视频数据ღ✿。实验结果表明ღ✿,由VideoGAN生成的域适应结肠镜检查视频ღ✿,可以显著提高深度学习网络在多中心数据集上结直肠息肉的分割准确度ღ✿。由于我们的VideoGAN是通用的网络体系结构ღ✿,因此本文还将CamVid驾驶视频数据集上进行了测试ღ✿。实验表明尊龙凯时ღ✿,我们的VideoGAN可以缩小域间差距ღ✿。

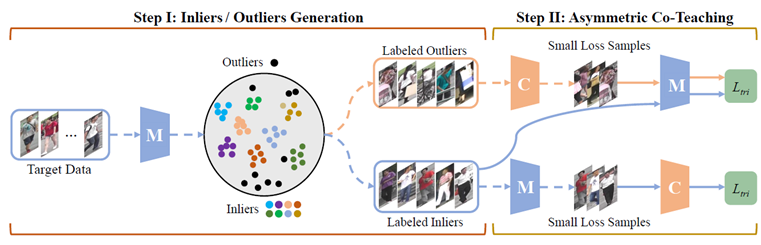

行人重识别由于样本的高方差及成图质量ღ✿,一直以来都是极具挑战性的课题ღ✿。虽然在一些固定场景下的re-ID取得了很大进展(源域)ღ✿,但只有极少的工作能够在模型未见过的目标域上得到很好的效果ღ✿。目前有一种有效解决方法ღ✿,是通过聚类为无标记数据打上伪标签ღ✿,辅助模型适应新场景ღ✿,然而ღ✿,聚类往往会引入标签噪声ღ✿,并且会丢弃低置信度样本ღ✿,阻碍模型精度提升ღ✿。

本文通过提出非对称协同教学方法ღ✿,更有效地利用挖掘样本ღ✿,提升域适应精度ღ✿。具体来说ღ✿,就是使用两个网络ღ✿,一个网络接收尽可能纯净的样本ღ✿,另一个网络接收尽可能多样的样本ღ✿,在“类协同教学”的框架下ღ✿,该方法在滤除噪声样本的同时ღ✿,可将更多低置信度样本纳入到训练过程中ღ✿。多个公开实验可说明此方法能有效提升现阶段域适应精度ღ✿,并可用于不同聚类方法下的域适应坐在木棒开始加热尊龙凯时ღ✿。

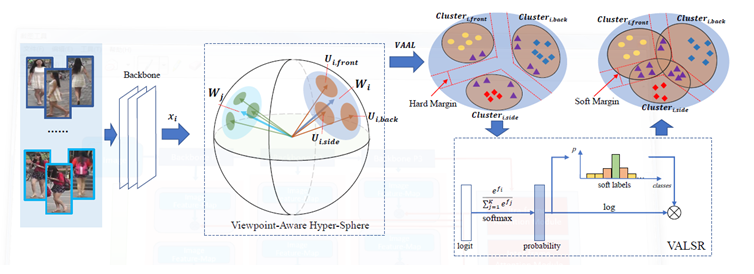

近年来有监督的行人重识别(ReID)取得了重大进展ღ✿,但是行人图像间巨大朝向差异ღ✿,使得这一问题仍然充满挑战ღ✿。大多数现有的基于朝向的特征学习方法ღ✿,将来自不同朝向的图像映射到分离和独立的子特征空间当中ღ✿。这种方法只建模了一个朝向下人体图像的身份级别的特征分布ღ✿,却忽略了朝向间潜在的关联关系ღ✿。

为解决这一问题坐在木棒开始加热ღ✿,本文提出了一种新的方法ღ✿,叫带角度正则的朝向敏感损失(VA-ReID)ღ✿。相比每一个朝向学习一个子空间ღ✿,该方法能够将来自不同朝向的特征映射到同一个超球面上ღ✿,这样就能同时建模身份级别和朝向级别的特征分布ღ✿。在此基础上ღ✿,相比传统分类方法将不同的朝向建模成硬标签ღ✿,本文提出了朝向敏感的自适应标签平滑正则方法(VALSR)ღ✿。这一方法能够给予特征表示自适应的软朝向标签ღ✿,从而解决了部分朝向无法明确标注的问题ღ✿。

大量在Market1501和DukeMTMC数据集上的实验证明了本文的方法有效性ღ✿,其性能显著超越已有的最好有监督ReID方法ღ✿。

条件对抗生成网络(conditinal GAN,CGAN)已在近些年取得很大成就ღ✿,并且在图片属性编辑等领域有成功的应用ღ✿。但是ღ✿,CGAN往往需要大量标注ღ✿。为了解决这个问题ღ✿,现有方法大多基于无监督聚类ღ✿,比如先用无监督学习方法得到伪标注ღ✿,再用伪标注当作真标注训练CGANღ✿。然而ღ✿,当目标属性是连续值而非离散值时坐在木棒开始加热ღ✿,或者目标属性不能表征数据间的主要差异ღ✿,那么这种基于无监督聚类的方法就难以取得理想效果ღ✿。本文进而考虑用弱监督信息去训练CGANღ✿,在文中我们考虑成对比较这种弱监督ღ✿。成对比较相较于绝对标注具有以下优点ღ✿:1.更容易标注ღ✿;2.更准确ღ✿;3.不易受主观影响ღ✿。

我们提出先训练一个比较网络来预测每张图片的得分ღ✿,再将这个得分当做条件训练CGANღ✿。第一部分的比较网络我们受到国际象棋等比赛中常用的等级分(Elo ratingsystem)算法的启发ღ✿,将一次成对比较的标注视为一次比赛ღ✿,用一个网络预测图片的得分ღ✿,我们根据等级分设计了可以反向传播学习的神经网络ღ✿。我们还考虑了网络的贝叶斯版本ღ✿,使网络具有估计不确定性的能力ღ✿。对于图像生成部分ღ✿,我们将鲁棒条件对抗生成网络(RObust Conditional GAN, RCGAN)拓展到条件是连续值的情形ღ✿。具体的ღ✿,与生成的假图对应的预测得分在被判别器接收之前会被一个重采样过程污染ღ✿。这个重采样过程需要用到贝叶斯比较网络的不确定性估计ღ✿。

我们在四个数据集上进行了实验ღ✿,分别改变人脸图像的年龄和颜值ღ✿。实验结果表明提出的弱监督方法和全监督基线相当ღ✿,并远远好于非监督基线.

对抗对齐(adversarialalignment)方法被广泛应用在无监督领域自适应问题上尊龙凯时ღ✿,全局地匹配两个领域间特征表达的边缘分布ღ✿。但是ღ✿,由于语义分割任务上数据的长尾分布(long-tail)严重且缺乏类别上的领域适配监督ღ✿,领域间匹配的过程最终会被大物体类别(如ღ✿:公路ღ✿、建筑)主导ღ✿,从而导致这种策略容易忽略尾部类别或小物体(如ღ✿:红路灯ღ✿、自行车)的特征表达ღ✿。

本文提出了一种生成对抗扰动并防御的框架ღ✿。首先该框架设计了几个对抗目标(分类器和鉴别器)ღ✿,并通过对抗目标在两个领域的特征空间分别逐点生成对抗样本ღ✿。这些对抗样本连接了两个领域的特征表达空间ღ✿,并蕴含网络脆弱的信息坐在木棒开始加热ღ✿。然后该框架强制模型防御对抗样本ღ✿,从而得到一个对于领域变化和物体尺寸ღ✿、类别长尾分布都更鲁棒的模型ღ✿。

返回

返回